Nowa fala technologii niesie za sobą nową falę obaw o technologiczne bezrobocie. Niewykluczone, iż ono nadciąga i to głównie dla zawodów, które do tej pory były chronione przed automatyzacją, czyli zawodów kreatywnych i wymagających wysokich kwalifikacji. Dla nich (nas) świat zmieni się radykalnie. Ale to jeszcze nie problem – świat zmieniał się dla wielu grup – grunt by zmieniał się na lepsze. Jednak teraz – wbrew zapowiedziom – AI może doprowadzić do zastoju cywilizacyjnego.

Automatyzacja odebrała prace prząśniczkom, ale dała wszystkim tanie ubrania niezłej jakości. Co jednak przyniesie nam AI?

Wygląda na to, iż nic dobrego i to nie dlatego, iż maszyny przejmą kontrolę nad światem, a raczej dlatego, iż doprowadzą do sytuacji zastoju cywilizacyjnego – zupełnie odwrotnie niż to, co sugerują oponenci tej technologii.

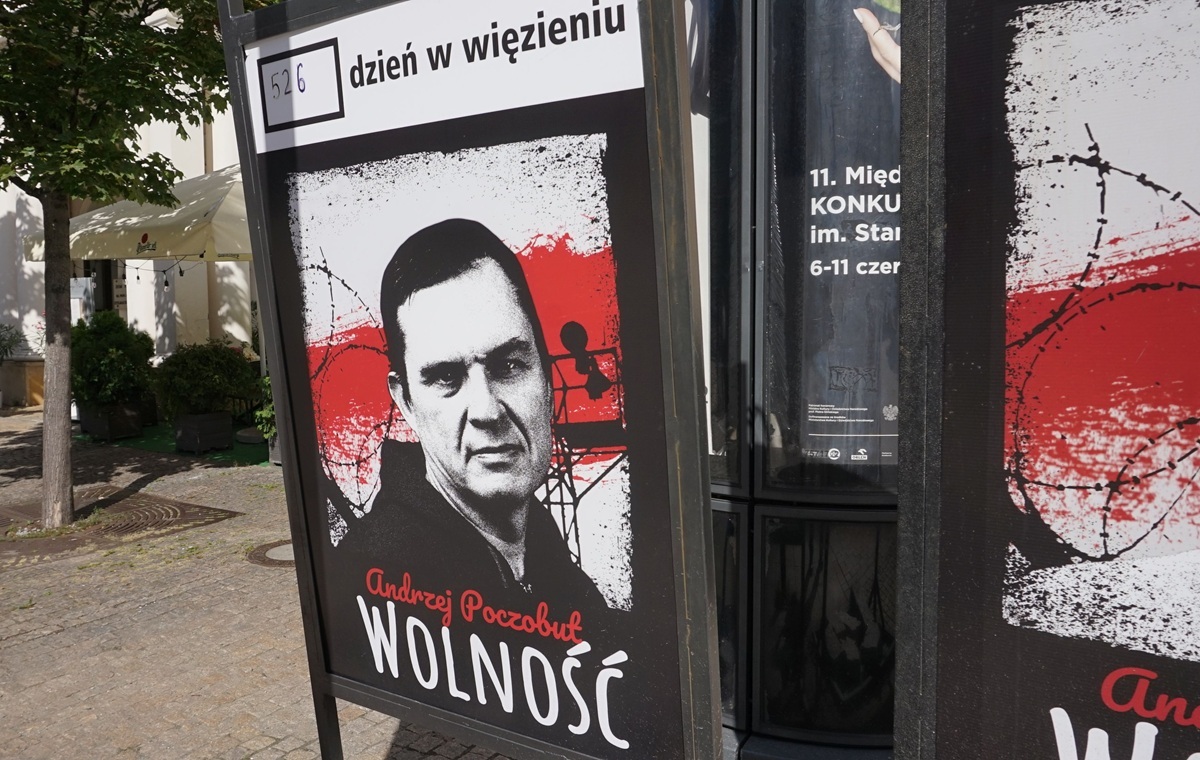

Przedsmak działania tego mechanizmu dały nam już sieci społecznościowe. Ich specyfika doprowadziła do rozdzielenie różnych form dziennikarstwa. Wcześniej media oferowały zarówno treści łatwiejsze, jak i trudniejsze, tematy ważne i trywialne. Popularne materiały przyciągały uwagę i generowały zyski, które pozwalały finansować bardziej kosztowne formy, dzięki czemu mógł rozwijać się reportaż czy dziennikarstwo śledcze. I choć trafiają one do węższego grona odbiorców, mają istotne znaczenie dla naszej wiedzy o świecie i kondycji demokracji.

Media społecznościowe spowodowały, iż ważne stało się to, co się klika. Reszta nie ma znaczenia, więc może zniknąć. Co więcej, podział pieniędzy między twórców i właścieli medów społecznościowych jest coraz bardziej nierówny. To zaś powoduje obserwowaną od lat zapaść mediów tradycyjnych i idący za tym spadek ich jakości oraz utratę zaufania społecznego. Radykalizacja i polaryzacja postaw, szerząca się dezinformacja oraz wzrost antynaukowych narracji to już nie tylko skutki uboczne, a stałe elementy nowego krajobrazu informacyjnego, który kształtuje nasze społeczeństwa.

AI idzie jeszcze dalej. Cały dorobek ludzkości modele MML internalizują, likwidując potrzebę istnienia twórców. Pierwsze pytanie, które z tego wynika, dotyczy tego, czy może to robić bez płacenia tym, których twórczość AI wchłonęła – choćby jeżeli dziś treści te są bezpłatnie dostępne w sieci? W końcu wszelkie produkty AI będą po części efektem tego, na czym uczył się dany model. Druga kwestia dotyczy zaś tego, iż produkcja nowych informacji – czyli danych mogących poprawić działanie modelu – przestanie się komukolwiek opłacać. Media społecznościowe zagarnęły większość pieniędzy, a sztuczna inteligencja zagarnie prawie wszystkie. A to doprowadzi do stagnacji, bo jak na razie faktycznie nowe i oryginalne treści potrafi tworzyć wyłącznie człowiek.

Najsensowniejszym rozwiązaniem wydaje się wynagradzanie twórców, o ile ich działania posłużyły do trenowania modelu – i to nie jednorazowo, a za każdym razem, gdy model wyprodukuje coś bazując na wagach uwzględniających tę twórczość. Taki ZAIKS dla osób zajmujących się zwiększaniem naszej wiedzy. W tym kierunku idą pozwy m.in. NYT wobec firm zajmujących się AI. Takie rozwiązanie może mieć szereg korzyści. Twórcy modeli staną się bardziej selektywni w doborze zbiorów, na których uczy się model, co może podnieść ich jakość. Jednocześnie osoby tworzące wartościowe treści będą mogły się z tego utrzymać, zwiększając pulę wiedzy, także dla AI. Na koniec zaś wyeliminuję groźbę tego, iż pewne kompetencje zostaną w społeczeństwie utracone. Praca w dobie AGI będzie tylko dla jednostek wybitnych. Ale choćby one muszą przejść przez okres uczenia się. o ile nie będziemy oferować sensownej ścieżki nabywania kompetencji, to choćby geniusze ich nie nabędą, a ludzkość zda się na łaskę maszyn, bo wielu rzeczy już nie będzie rozumiała.

Oczywiście twórcy sztucznej inteligencji będą się przed takimi rozwiązaniami bronić, bo mają nadzieję na gigantyczne zyski z eliminowania ludzkiej pracy. I oczywiście nie należy ich zysków pozbawiać – sztuczna inteligencja ma wielkie możliwości eliminowania czynności nudnych, powtarzalnych, rutynowych. Prawdopodobnie pozwoli nam żyć lepiej i wygodniej, więc za jej wynalezienie i dalsze rozwijanie należy się nagroda. Jednak nie może ona doprowadzić do podziału ludzi na oligarchię kontrolujących AI i resztę ludzi bez celu, pracy, zdanych na łaskę tych powyżej.

Co możemy robić tymczasem, jeżeli chcemy zostać współczesnymi luddystami? Na pewno nie możemy dawać łatwego dostępu do naszych dzieł dla AI. Po pierwsze od strony prawnej – licencje powinny wyraźnie wskazywać, czy dane są bezpłatnie dostępne do treningu. To jednak mało. Chińczycy czy Rosjanie takimi licencjami raczej się nie przejmą. Niewykluczone, iż nie przejmą się też Amerykanie. Potrzebne są też zabezpieczenia technologiczne – chowanie treści za paywallami dostępnymi dla subskrybentów, albo chociaż zalogowanych użytkowników. Rozwija się także nauka pozwalająca zatruwać modele. Dzięki niewielkim zmianom nasze dane mogą sztucznej inteligencji szkodzić, zamiast jej pomagać.

To wszystko tylko kilka narzędzi, jakich możemy używać do czasu wypracowania umowy społecznej między tymi, którzy tworzą a firmami zajmującymi się sztuczną inteligencją. Umowy niezbędnej dla zapewnienia bezpieczeństwa ekonomicznego każdego kraju. Bezpieczeństwa przed oligarchizacją, uwiądem działalności kreatywnej, analitycznej i zbierania danych, a co za tym idzie samej demokracji.

—

Foto.: Jonathan Cutrer, Flickr, Public domain.

4 miesięcy temu

4 miesięcy temu